はじめに — こんな不安、ありませんか?

「AIを業務に入れたいけど、もし事故が起きたら誰の責任になるの?」

お客様との打ち合わせで、この質問をいただくことが本当に増えました。AIチャットボットが誤った案内をしてクレームになったら? AIが出した検査結果を信じて不良品を出荷してしまったら? ——考え始めるとキリがなく、結局「まだ早いかな」と導入を見送る。そんな経営者の方も多いのではないでしょうか。

この「モヤモヤ」に、国がひとつの答えを出しました。

2026年4月9日、経済産業省が「AI利活用における民事責任の解釈適用に関する手引き」を公表しました。AI利用時に損害が発生した場合、現行法でどう責任が判断されるのかを、7つの具体的な事例とともに整理した、AI民事責任に焦点を当てた初の手引きです。

この記事では、法律の専門家でなくても「要するにどういうことか」がわかるよう、中小企業の経営者の視点でポイントを解説します。

1. そもそも、なぜ今この手引きが必要なのか

AIの導入が進む一方で、「AIが原因で損害が起きた」裁判の前例は、日本にはほとんどありません。 前例がないということは、開発する側も使う側も「何をしていれば責任を問われないのか」がわからないということです。

この不透明さが、特に中小企業のAI導入を阻む大きな壁になっていました。

今回の手引きは、新しい法律を作るのではなく、今ある法律(民法の不法行為責任、製造物責任法)をAIの場面にどう当てはめるかの考え方を示したものです。法的な拘束力はありませんが、国の公式見解として裁判所が参考にする可能性があり、いわば「国が示した解釈のものさし」です。

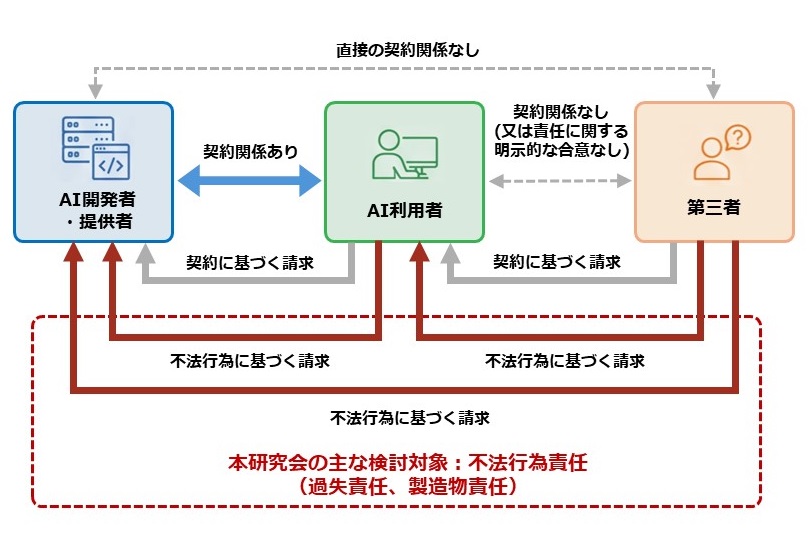

上の図は手引きの中心的な構造を示しています。AI開発者・AI利用者・第三者(被害者)の3者間で、契約に基づく請求と不法行為に基づく請求がどう流れるかを整理したものです。

2. 知っておくべき最大のポイント —— AIは「2タイプ」に分かれる

手引きの核心は、AIの使い方を2つのタイプに分け、タイプごとに責任の考え方を整理したことです。

補助・支援型AI — 「最後に決めるのは人間」

AIの出力はあくまで参考情報。最終的な判断は人間が行う前提のAIです。

具体例:

- 配送ルートの最適化提案をしてくれるAI

- 弁護士の判例調査を手伝うAI

- 取引先の審査をサポートするAI

責任の考え方:

AIが間違えた情報を出しても、それをそのまま使って損害が出た場合、責任は「使った人」に寄る傾向があります。なぜなら、「参考にするだけで、最終判断は自分でする」のがこのタイプの前提だからです。

たとえば、弁護士支援AIが過去の判例を間違えて表示し、弁護士がそれを検証せず使って敗訴した場合、責任はAI開発会社ではなく弁護士に帰属しやすいとされています。

依拠・代替型AI — 「AIが人の代わりに判断する」

人が全件処理するのが困難な作業を、AIが人に代わって判断・実行するタイプです。

具体例:

- 工場の外観検査を自動化するAI

- 倉庫内を自律走行する搬送ロボット(AMR)

責任の考え方:

AIが人の代わりを務める以上、開発者には「人と同等以上の精度・安全性を確保する義務」が課されます。利用者にも、適切な運用体制を構築する責任が求められます。

一目でわかる比較表

| 補助・支援型 | 依拠・代替型 | |

|---|---|---|

| 人の関与 | 人が最終判断 | AIが代行 |

| 利用者の義務 | AIの出力を検証して使う | リスク管理しながら運用する |

| 開発者の義務 | AIの限界を説明する | 高い精度・安全性を維持する |

| 責任が寄りやすい先 | 利用者 | 開発者(の比重が増す) |

3. あなたの会社はどっちのタイプ?

ここが実務で一番大事なところです。「うちが使っているAI(これから入れるAI)はどちらか?」を判断する基準をまとめます。

補助・支援型に該当するケース:

- AIの提案を社員が確認してから実行している

- AIの出力が「たたき台」や「候補リスト」として使われている

- 最終的なGo/No-Goの判断に人が介在している

依拠・代替型に該当するケース:

- AIの判定結果がそのまま業務のアウトプットになっている

- 人が全件チェックする前提になっていない

- AIが自動で次の工程に進むフローになっている

多くの中小企業で現在使われているAI(ChatGPTでの文章作成補助、AIによる請求書読み取り、チャットボットの一次対応など)は、ほとんどが「補助・支援型」に該当します。

つまり、最終判断を人間がしている限り、AIを使うことのリスクは従来の業務とさほど変わらないということです。

4. 中小企業が今やるべき3つのこと

(1) 自社のAI利用が「どちらのタイプか」を整理する

まず、社内で使っているAIツールを一覧にし、それぞれについて「最後に人が確認しているか?」をYes/Noで書き出してみましょう。タイプを明確にすることで、取るべき対策が変わります。

(2) 「人が確認するステップ」をルール化する

補助型であれば、AIの出力を人が確認してから使うフローを社内ルールとして明文化しておくことが最大の防御策になります。口頭の慣習ではなく、業務マニュアルやチェックリストに落とし込むことが重要です。

(3) AIの導入時に「説明を受けた記録」を残す

AI製品を導入する際、開発会社や販売会社から精度の限界やリスクについて説明を受け、その記録を残すことをおすすめします。導入時の説明メール・提案書・契約書を1つのフォルダにまとめておくだけでも十分です。万が一のとき「適切にリスクを認識して運用していた」ことの証拠になります。

5. 気になるQ&A

Q. AIが原因で損害が出たら、被害者は簡単に訴えられる?

必ずしも簡単ではありません。 AIのブラックボックス性(なぜそう判断したか外から見えない)と、開発データやログが開発者側に偏在する構造から、被害者が「過失」や「欠陥」を証明するハードルは高いとされています。手引きでは、裁判所が開発者にデータ提出を命じる制度の活用や、状況証拠からの推定など、被害者保護の方向性も示しています。

Q. AIエージェント(自律的に判断・行動するAI)の責任は?

現時点では「整理が困難」とされています。 手引きの中でも「補論」として扱われ、今後の技術進化に合わせて継続的に見直すとされています。AIエージェントが複数のツールを自律的に呼び出して作業を進めるような場面では、「誰が指示したか」「どこまでがAIの自律判断か」の線引きが難しく、今後の重要論点です。

Q. うちは小さな会社だけど、本当に関係ある?

あります。 むしろ中小企業こそ、AI導入時の責任リスクを事前に理解しておくことが大切です。大企業には法務部門がありますが、中小企業では経営者自身がリスク判断をすることが多いからです。この手引きは、まさにその判断材料を提供してくれるものです。

6. まとめ — AI導入を「正しく怖がる」ために

今回の手引きが伝えているメッセージは、実はシンプルです。

- AIは「道具」である以上、使い方によって責任の所在は変わる

- 「参考として使う」なら、使う側が確認する義務を果たせばよい

- 「AIに任せる」なら、開発者にも利用者にもより高い責任が求められる

「AIだから特別」ではなく、従来の法律の延長線上で考えられるという整理は、AI導入を検討している経営者にとって安心材料になるはずです。

大事なのは、漠然と恐れて導入を見送ることではなく、リスクの正体を知ったうえで、適切な運用ルールを整えること。今回の手引きは、そのための「ものさし」を私たちに提供してくれています。