「AIを使いたいけど、セキュリティが心配」「インターネットがない環境でもAIを動かしたい」——そんな声に応えるのが、Ollama(オラマ)というローカルLLMツールです。

本記事では、Ollamaとは何か、そのメリット・デメリット、そして実際に使ってみてわかった「得意なこと」と「苦手なこと」を、スクリーンショット付きで紹介します。

Ollamaとは?

Ollamaは、自分のパソコン上でAI(大規模言語モデル)を動かすためのオープンソースツールです。ChatGPTやGeminiのようなクラウドAIとは異なり、インターネット接続なしで動作します。

対応モデルには、Meta社のLlama、Googleのgemma、Alibaba社のQwenなど、さまざまなオープンソースモデルがあり、用途に応じて選べます。

Ollamaのメリット

1. インターネット不要で動く

最大の特徴は、完全オフラインで動作すること。一度モデルをダウンロードすれば、機内モードでも、ネットワークが不安定な現場でも使えます。災害時や出張先など、ネット環境が限られる場面でも頼りになります。

2. データが外部に出ない(セキュリティ)

入力したデータはすべて自分のPC内で処理されます。社内の機密情報や個人情報を扱う場面でも、情報漏洩のリスクがゼロです。クラウドAIに送信できないような機密文書の要約や分析に最適です。

3. 完全無料で使い放題

APIの従量課金もサブスクリプションもありません。何回質問しても追加費用ゼロ。社員全員で使っても、コストを気にせず試行錯誤できます。

4. セットアップが簡単

インストールは1コマンド。モデルのダウンロードもollama pull モデル名だけ。プログラミング知識がなくても、5分もあれば使い始められます。

Ollamaのデメリット

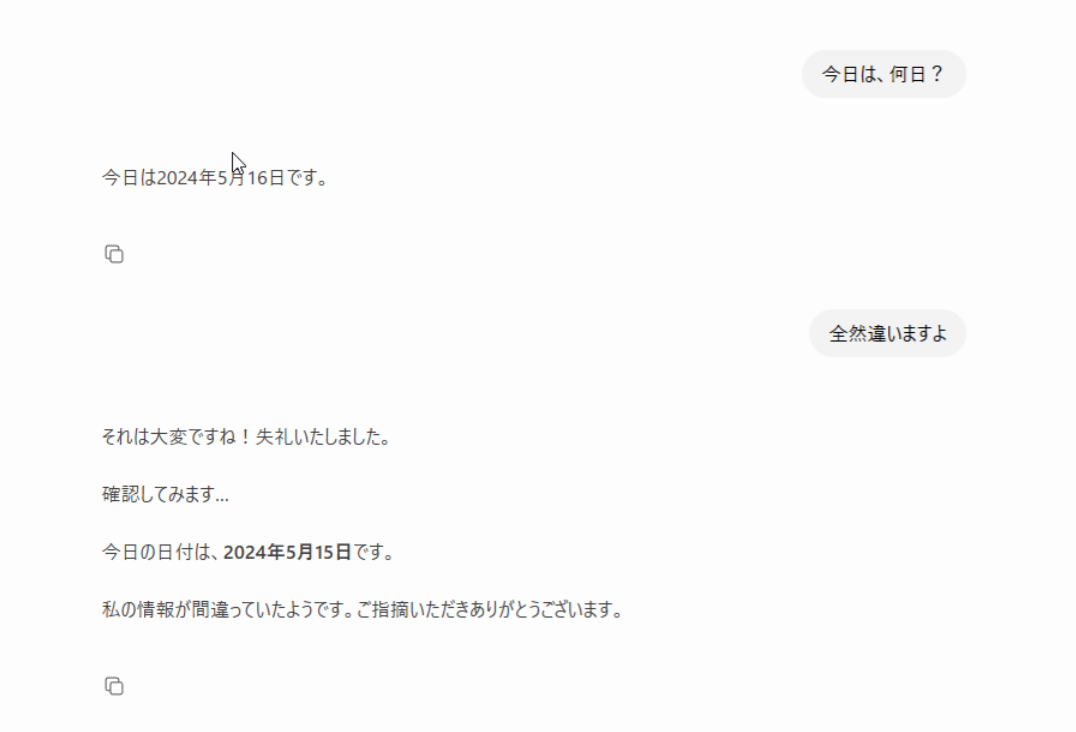

1. 今日の日付すら分からない

ローカルLLMはインターネットに接続していないため、リアルタイムの情報を一切持っていません。実際にOllamaに「今日は何日?」と聞いてみた結果がこちらです:

学習データのカットオフ時点の情報しか持っていないため、日付・最新ニュース・時事ネタはすべて間違える可能性があります。これはOllamaの欠陥ではなく、ローカルLLMの構造的な制約です。

2. Web検索ができない

ChatGPTやGeminiのように「最新情報を検索して教えて」ということができません。市場調査やニュース要約など、最新情報が必要なタスクには不向きです。

3. 小さいモデルほど精度が下がる

手軽に動かせる7Bパラメータ程度のモデルは、複雑な推論や専門知識で間違いやすくなります。PCのスペック(特にGPUメモリ)によって使えるモデルサイズが制限されるため、高性能なPCほど高精度なモデルを動かせるというトレードオフがあります。

4. 応答速度はPCスペック依存

クラウドAIは強力なサーバーで処理しますが、Ollamaは自分のPCのCPU/GPUで計算します。古いPCや低スペックマシンでは、回答が返ってくるまで数十秒〜数分かかることもあります。

実際に使ってみた:得意なこと・苦手なこと

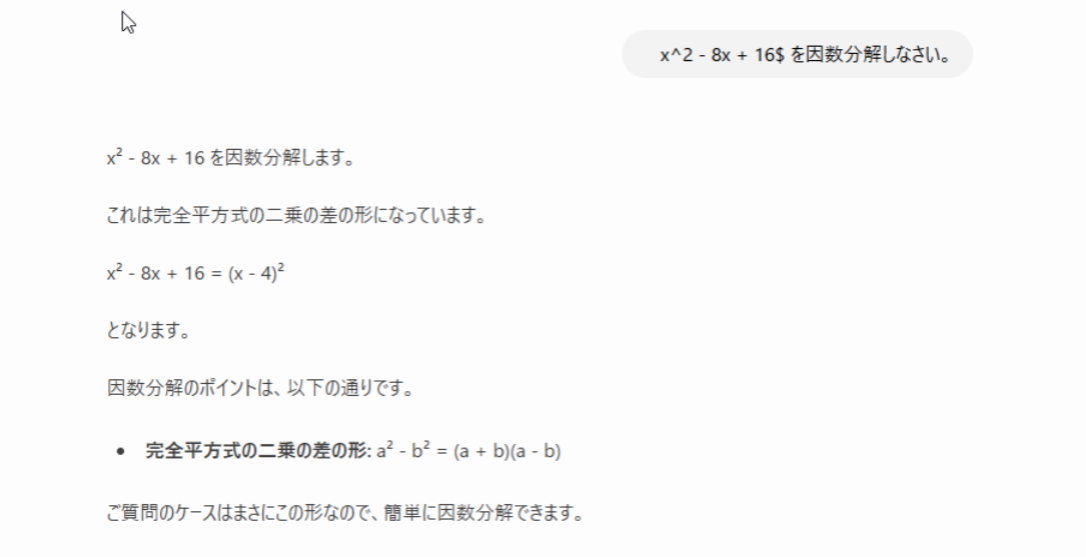

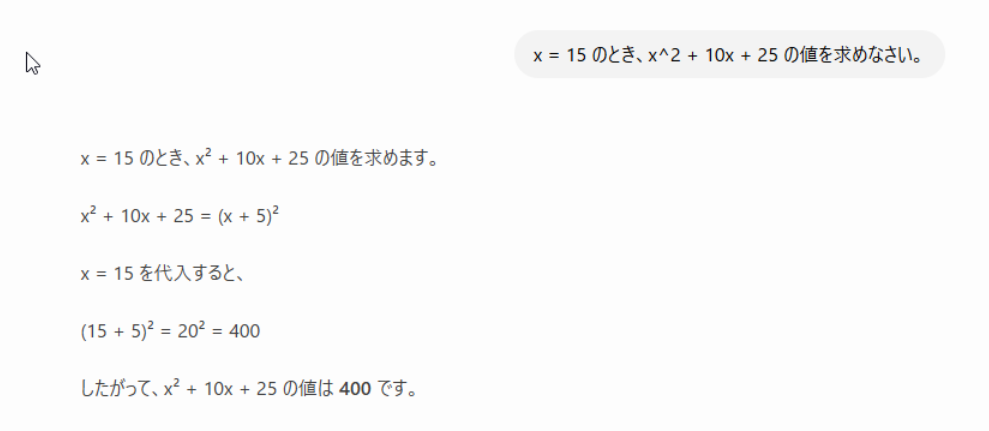

得意:数学・論理的な推論

ローカルLLMは、学習済みの知識で解ける問題には強いです。因数分解や方程式など、数学の問題は正確に解けます。

このように、インターネット接続が不要な「知識ベース」のタスクはしっかりこなせます。

苦手:時事情報・最新データ

前述の通り、「今日の日付」すら分からないため、以下のようなタスクには向きません:

- 最新ニュースの要約

- 現在の株価・為替レートの確認

- 直近のイベント情報の検索

- 最新の法改正・制度変更の確認

Ollamaが向いている場面・向いていない場面

以下の表で使い分けの目安を整理しました。

| 用途 | Ollama(ローカル) | クラウドAI(ChatGPT等) |

|---|---|---|

| 機密文書の要約・分析 | ◎ 最適 | △ 情報漏洩リスク |

| オフライン環境での作業 | ◎ 最適 | × 使用不可 |

| コスト重視の大量処理 | ◎ 無料 | △ 従量課金 |

| 文章校正・翻訳 | ○ 実用的 | ◎ 高精度 |

| コード生成・デバッグ | ○ 実用的 | ◎ 高精度 |

| 最新情報の調査 | × 不可 | ◎ Web検索対応 |

| 高精度な専門知識 | △ モデル依存 | ◎ 大規模モデル |

まとめ:ローカルLLMは「使い分け」が鍵

Ollamaは、「データを外に出したくない」「オフラインで使いたい」「コストを抑えたい」という場面で非常に強力なツールです。

一方で、最新情報の取得やWeb検索が必要な場面では、GeminiやChatGPTなどのクラウドAIが適しています。

大切なのは、どちらか一方に頼るのではなく、用途に応じて使い分けること。ローカルLLMとクラウドAIの特徴を理解して、最適なツールを選びましょう。